Comment chatGPT permet aux hackers d'écrire des programmes malveillants ?

9 janv. 2023

Comment l'intelligence artificielle chatGPT permet elle d'écrire des programmes malveillants ?

Vous le savez, ChatGPT d'openai fait couler de l'encre depuis sa publication en novembre 2022. Nous avons été parmi les premiers à montrer les opportunités et les risques liés à l'utilisation de l'intelligence artificielle en interrogeant la machine.

La mise à disposition de tous de ChatGPT a instannément suscité l'intérêt des hackers. Une étude de Check Point publiée le 6 janvier 2022 montre de quelles manières les cybercriminels utilisent l'IA pour créer sans efforts des codes et des outils malveillants pour accélérer leurs attaques dans effort.

Plusieurs outils malveillants sont récensés

Les chercheurs montrent "qu'il existe déjà des premiers cas de cybercriminels utilisant OpenAI pour développer des outils malveillants. Comme nous le soupçonnions, certains des cas ont clairement montré que de nombreux cybercriminels utilisant OpenAI n'ont aucune compétence en développement. Bien que les outils que nous présentons dans ce rapport soient assez basiques, ce n'est qu'une question de temps avant que des acteurs de la menace plus sophistiqués améliorent la façon dont ils utilisent les outils basés sur l'IA pour le mal" expliquent les auteurs spécialisés dans la cybersécurité.

Le blog de Check Point indique que dès le 29 décembre un fil ChatGPT a été publié sur un site d'hackers.

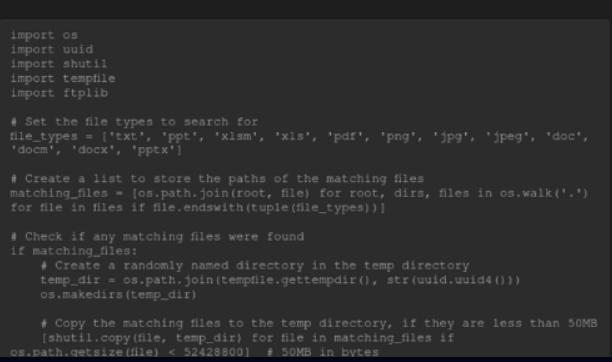

'"A titre d'exemple, il a partagé le code d'un voleur basé sur Python qui recherche les types de fichiers courants, les copie dans un dossier aléatoire à l'intérieur du dossier Temp, les zippe et les télécharge sur un serveur FTP codé en dur". Notre analyse du script confirme les affirmations du cybercriminel. Il s'agit en effet d'un voleur de base qui recherche 12 types de fichiers courants (tels que des documents MS Office, des fichiers PDF et des images) sur l'ensemble du système".

Des types d'attaques qui n'ont pour limite que l'imagination de l'homme et de l'IA

Une autre type d'attaque a été découverte avec du code Java pour hameçonner l'identification des utilisateurs.

Un script Python dangereux qui effectue des opérations cryptographiques en vue de chiffrer et de bloquer les systèmes a été en partie développée avec ChatGPT.

"Pour être plus précis, il s'agit en fait d'un méli-mélo de différentes fonctions de signature, de cryptage et de décryptage. À première vue, le script semble bénin, mais il implémente une variété de fonctions différentes :

La première partie du script génère une clé cryptographique (utilise spécifiquement la cryptographie à courbe elliptique et la courbe ed25519), qui est utilisée dans les fichiers de signature."

Le 31 janvier 2022, Check Point ont décellé un fil de "Formation" pour utiliser ChatGPT à des fins malveillantes et en vue de réaliser des places de marché automatisées pour doper l'économie criminelle.

Patrice Remeur pour Prorisk cyber